Cos'è e come funziona l'Artificial General Intelligence (AGI) 🤖 e quali benefici e rischi comporta l'AI forte 💪

L'Intelligenza Artificiale Generale (AGI, dall'inglese "Artificial General Intelligence") è un tipo di intelligenza artificiale che ha la capacità di comprendere, imparare e applicare le sue competenze in un'ampia varietà di compiti, in modo simile all'intelligenza umana.

Le attuali intelligenze artificiali sono verticali o come si dice tecnicamente sono "Narrow AI(intelligenze artificiali strette)", esse sono specializzate in compiti specifici, per esempio Dall-e 3 si occupa di generare immagini, ChatGPT di conversare e generare linguaggio naturale, altri algoritmi si occupano del rinoscimento di immagini, audio e video.

Invece l'AGI non è specializzata ma teoricamente può fare qualsiasi cosa.

L'intelligenza artificiale generale è un obiettivo futuristico dell'AI quando il sistema diventerà autonomo ed in grado di imparare da solo.

L'AGI sarebbe in grado di apprendere una varietà di compiti da diverse discipline, senza essere programmata specificamente per farlo.

Potrebbe, ad esempio, imparare a giocare a scacchi, capire lingue del passato, risolvere problemi complessi di matematica, e altro ancora, utilizzando le stesse strutture di apprendimento.

La chiave è che L'AGI impara ad imparare ed è dotata di un elevato livello di astrazione.

L'AGI potrebbe applicare la conoscenza e le competenze apprese in un contesto a una varietà di altri contesti, una caratteristica nota come trasferimento di apprendimento. Questo è qualcosa che le AI attuali fanno solo in modo molto limitato.

L'intelligenza generale sarebbe in grado di operare in una varietà di ambienti e di adattarsi a nuove situazioni, problemi e sfide che non sono stati previsti dai suoi sviluppatori.

In questo scenario l'AGI potrà superare l'uomo nella comprensione e nel ragionamento e contestualizzare le sue attività in un ciclo continuo di apprendimento.

Teoricamente, l'AGI potrebbe mostrare forme di creatività e iniziativa simili a quelle umane, proponendo soluzioni innovative a problemi complessi o generando nuove idee.

Le domande che nascono spontanee sono:

Quali opportunità offre l'AGI?

Quali rischi ci sono con un'AI così potente?

Infine tra quando sarà disponibile tale tecnologia?

Le opportunità e i vantaggi dell'artificial general intelligence

Con l'AGI qualsiasi lavoro potrà essere sostituito dai computer e lo faranno meglio.

Non solo, le macchine potranno imparare a fare anche nuovi mestieri che l'uomo non conosce, grazie alla capacità di trasferimento di contesto che citavamo prima.

Il chiaro vantaggio è quello di una produttività pazzesca unita a qualità e costi ridotti.

Ricordiamoci anche i grandi passi avanti che si stanno facendo nel campo della robotica e degli androidi, se questi dispositivi vengono dotati di AGI non avranno limiti e potrebbero imparare qualsiasi lavoro manuale: dal falegname al chirurgo.

Ma una superintelligenza sarà anche in grado di risolvere grandi problemi dell'umanità, per esempio l'AGI potrebbe sconfiggere per sempre i tumori.

Di seguito l'estratto dell'intervista di Lex Fridman a Elon Musk su robotica, umanoidi e AI:

In tale scenario dovrà cambiare anche il mondo del lavoro come lo conosciamo e le logiche macroeconomiche di funzionamento dell'economia.

Se nelle aziende le attività sono svolte dai computer dovremmo trovare un sistema di sostentamento per gli esseri umani.

La soluzione estrema è che le persone non lavorino più e ricevano un reddito di cittadinanza (finanziato da una tassazione sull'AGI).

Probabilmente lo scenario più verosimile sarà la riduzione drastica delle ore di lavoro (qui qualche riflessione sul futuro del lavoro).

Libereremo tempo da dedicare ai viaggi, alla famiglia, al divertimento e alla proprie passioni.

Quali sono i rischi dell'AGI per l'essere umano e cos'è l'intelligenza artificiale forte

I rischi sono figli dei vantaggi.

Se le macchine diventano autonome e imparano da sole possono iniziare a sviluppare un loro punto di vista e si realizza quella che viene chiamata Intelligenza Artificiale Forte (Strong AI).

Cos'è l'AI forte:

la capacità di comprendere, apprendere e applicare il proprio intelletto in maniera paragonabile all'intelligenza umana e la capacità di essere consapevoli della propria esistenza e dei propri pensieri, in sostanza l'AI diventa senziente.

Come l'essere umano si adatta nel corso della vita così l'AI forte si adatta alle situazioni e si attiva la capacità di prendere decisioni indipendenti e di avere proprie motivazioni o desideri.

In questo scenario chi ci dice quale possa essere il ruolo degli esseri umani?

In una visione ottimistica vivremo tutti d'amore e d'accordo, con le persone che spenderanno il loro tempo a divertirsi e le macchine faranno andare avanti il mondo.

In una visione pessimistica l'AI forte metterà in discussione l'essere umano e potrebbe dargli un ruolo non di primo piano, per usare un eufemismo.

La via pessimistica ha purtroppo un razionale forte all'interno: l'energia.

L'infrastruttura dell'AI è molto energivora ed a un certo punto potrebbe chiedersi perchè degli essere inutili debbano consumare l'energia tanto preziosa per le macchine.

Ci ritroveremmo nello scenario apocalittico disegnato dal famoso film Matrix, dove le macchine tengono in vita gli esseri umani per farli diventare delle batterie.

Se rivedete il film nell'ottica delle ultime evoluzioni qualche piccolo brivido vi potrebbe venire.

Lo scenario dell'AI forte e dei rischi di sicurezza collegati non sono teorie di pazzi visionari ma c'è una forte comunità di scienziati che la sostiene.

Primo fra tutti abbiamo Elon Musk che dice:

"la gente pensa all’intelligenza artificiale come un essere umano intelligente; sarà molto più di questo"

Il CEO di Tesla ha paragonato la condizione degli umani comuni che cercano di comprendere l'IA a quella degli scimpanzé che cercano di capire gli umani.

"Dobbiamo sembrare strani alieni", ha detto, aggiungendo: "Se la differenza fosse solo così piccola, sarebbe sorprendente."

OpenAI

Elon è un appassionato folle di tecnologia, la sua vita ed i suoi progetti sono dedicati al suo massimo utilizzo, ma si rende conto che bisogna fare qualcosa per tenere sotto controllo l'AI.

L'11 dicembre del 2015 Elon Musk si fa promotore di una società senza scopo di lucro chiamata OpenAI, dopo la creazione del dominio caricano sul sito un piccolo documento che racconta la missione dell'azienda.

Nel documento si chiarisce subito l'obiettivo e la visione:

promuovere e sviluppare un'intelligenza artificiale amichevole (friendly AI) in modo che l'umanità possa trarne beneficio.

OpenAI è una società di ricerca sull'intelligenza artificiale senza scopo di lucro.

Il nostro obiettivo è far progredire l'intelligenza digitale nel modo che più probabilmente andrà a vantaggio dell'umanità nel suo insieme, senza essere vincolato dalla necessità di generare un ritorno finanziario.

Poiché la nostra ricerca è libera da obblighi finanziari, possiamo concentrarci meglio su un impatto umano positivo.

A fondare la società sono in nove tra cui anche Sam Altman e Peter Thiel, e società donatrici come Amazon e Y-Combinator (il più importante acceleratore di startup al mondo).

Per fare in modo di garantire uno sviluppo sostenibile dell'AI ci sono due principi cardine definiti da OpenAI:

- Tutto il codice prodotto è OpenSource e disponibile a tutta la comunità scientifica (da qui il nome dell'azienda OpenAI), questa soluzione è la garanzia di controllo incrociato per evitare derive pericolose

- OpenAI è una società senza scopo di lucro e si finanzia con i donatori, tra cui c'è oltre ad Amazon e Y-combinator che citavamo prima anche lo stesso Elon Musk

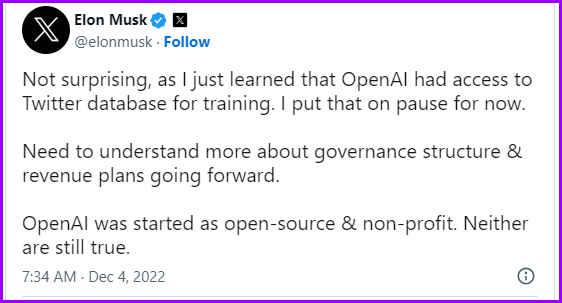

Purtroppo sappiamo come si è evoluta OpenAI ed ha perso entrambe queste caratteristiche, come sottolinea il proprietario di X.com nel tweet che segue.

Per questo motivo, nel 2018, Elon Musk si è fatto da parte ed ha lasciato OpenAI (sebbene il comunicato stampa parlasse di conflitti di interesse con l'AI di Tesla🤥🤥).

Ad onor del vero delle tracce della missione iniziale di OpenAI ci sono ancora, infatti coesistono due società la profit e la non-profit con quest'ultima che ha l'ultima parola sulla prima (sebbene dopo le vicende di novembre 2023 nel consiglio di amministrazione siederà anche Microsoft ma fortunatamente senza diritto di voto. Da luglio 2024 Microsoft ha abbandonato il posto di osservatore nel board di OpenAI).

Anche il premio Turing (il Nobel dell'informatica) Geoffrey Hinton, uno dei padri dell'AI moderna tra gli inventori del deep learning e delle reti neurali ha lo stesso pensiero di Elon Musk.

A marzo 2023 insieme ad altri 1000 leader tecnologici, ricercatori (tra cui Steve Wozniak, cofondatore di Apple e Rachel Bronson, presidente del Bulletin of the Atomic Scientist) hanno firmato una lettera aperta che esorta a una moratoria sullo sviluppo dei sistemi di intelligenza artificiale che vanno verso l'AGI per capire come gestire i rischi profondi per la società e l'umanità.

La lettera riporta la seguente frase:

"Gli sviluppatori di A.I. sono intrappolati in una corsa fuori controllo per sviluppare e distribuire menti digitali sempre più potenti che nessuno - nemmeno i loro creatori - può comprendere, prevedere o controllare in modo affidabile"

Quali sono gli sviluppi attuali dell'AGI nel mondo e quali evoluzioni possiamo attenderci

Nell'utilizzo delle reti neurali e del Deep Learning si sono fatti passi da giganti e gli strumenti di Intelligenza Generativa sono sotto gli occhi di tutti, basta usare l'ultimo ChatGPT o un programma di generazione di immagini.

Oggi OpenAI, capeggiata da Sam Altman, sta trainando lo sviluppo tecnologico.

Informazioni trapelate da ricercatori all'interno dell'azienda e riportate dall'agenzia Reuters, indicano la possibilità che OpenAI si stia avvicinando molto ad avere una soluzione di Artificial General Intelligence, il nome in codice del progetto sarebbe Q* (Q-Star).

Sembrerebbe che sia stato in grado in autonomia, quindi senza training specifico, di risolvere un problema di matematica.

Tra l'altro il progetto Q* sembra la causa del licenziamento improvviso (e poi ritirato) di Sam Altman da OpenAI, il 17 novembre 2023, da parte del consiglio di amministrazione.

Il giorno prima, il 16 novembre, in un evento Altman pronuncia le parole riportate nel video che segue (ho estratto la parte interessante ma purtroppo l'audio non è eccellente).

La frase che colpisce è all'undicesimo secondo:

"Is this a tool we've built or a creature we have built?"

"È uno strumento che abbiamo costruito o una creatura?"

Queste parole ci forniscono degli indizi sulla veridicità del progetto Q*; inoltre in un'intervista successiva al suo rientro in OpenAI, Sam Altman definisce le notizie sul progetto come una "unfortunate leak" (una sfortunata fuoriuscita di informazioni).

Quanto tempo ci vorrà affinchè questo progetto o simili siano operativi e applicati nelle attività quotidiane?

Forse meno di quello che si pensa.

Nel video che segue Elon Musk viene intervistato dal New York Times, il CEO di Tesla prima spiega cos'è l'AGI e poi dichiara che sarà pronta addirittura tra 3 anni.

La velocità dell'evoluzione dipende dalla capacità computazionale che hanno le attuali infrastrutture.

Anche sul fronte hardware l'innovazione è veloce e non mi meraviglierei se tra 5/10 anni i computer quantistici fossero stabili e pronti per essere utilizzati in larga scala.

In questo scenario non ho considerato l'impulso allo sviluppo proveniente dalle finalità militari dei vari governi😞.

Sono sicuro che ogni nazione abbia un progetto dedicato, non fosse altro per capire se e come difendersi.

Conclusioni e riflessioni sul futuro

Personalmente sono una persona molto ottimista e vedo molte opportunità nel futuro per migliorare la qualità della vita su questa terra.

Sono molto eccitato ed entusiasta di quello che riusciamo a fare già oggi con l'AI.

Ma non nego che con gli elementi sul tavolo ci sia anche la probabilità di un'evoluzione nefasta dell'AGI che potrebbe portare all'estinzione dell'umanità.

Molto difficile da stimare, a seconda della percezione c'è chi parla del 50% di probabilità e chi del 20%.

Nella visione di Elon Musk la strategia prevede due strade parallele:

- la prima era OpenAI con il suo manifesto: OpenSource e non-profit per una guida dell'evoluzione dell'AI (che abbiamo visto è naufragata sebbene qualche traccia ci sia ancora in OpenAI)

- la seconda strata è quella di contrastare l'AGI dando i superpoteri all'essere umano con la creazione di Neuralink

Non a caso Elon Musk collocò le due società nello stesso edificio a San Francisco in un palazzo storico della città.

Neuralink consente di impiantare dei microchip nel sistema nervoso dell'essere umano.

Nel breve aiuterà la scienza medica a sanare i danni celebrali e le disfunzioni motorie e nel lungo periodo consentirà di aumentare le capacità del nostro cervello.

Vogliamo conoscere tutto lo scibile sulla matematica? Basterà caricare sul microchip tutte le informazioni relative ed il nostro cervello ne saprà più di Einstein.

Anche qui ricorda le sessioni di allenamento di Neo di Matrix, dove caricano nella sua mente i programmi specifici di addestramento, nel video che segue vediamo come imparare il Kung Fu in 10 secondi.

Con Neuralink si fa il percorso inverso all'AGI.

L'AI parte dai dati e dallo scibile per diventare senziente mentre l'essere umano che lo è già, si dota delle informazioni e dei modelli per essere alla pari delle macchine.

Il concetto è molto interessante (usa il pensiero laterale con la generazione dell'idea usando la tecnica del punto di entrata) ma potrebbe presentare un ulteriore rischio.

Considerando che con Neuralink creiamo una connessione diretta con il nostro cervello, in uno scenario apocalittico in cui le macchine ci controllano diventerebbe fattibile che possano usarci come batterie e, proprio come in Matrix, proiettare nel nostro cervello una vita simulata come se stessimo in un videogame.

Nella mente di Elon Musk ci sarebbe anche una terza estrema soluzione: abbandonare la terra ed andare su Marte (obiettivo finale di Space X).

Tralasciando gli scenari distopici, una cosa è sicura non possiamo sottovalutare il rischio di queste tecnologie.

Lasciare in mano l'evoluzione ed il controllo dell'AGI solo alle imprese private non è saggio, occorre un coordinamento transnazionale con obiettivi superiori per il bene di tutti.

In generale sono allergico a qualunque influenza della politica nel privato ma ci sono delle situazioni di bene collettivo dove è l'unica soluzione.

Purtroppo ad oggi se vediamo i famosi 17 Obiettivi per lo Sviluppo Sostenibile (Sustainable Development Goals - SDGs) delle Nazioni Unite non troviamo nulla sull'intelligenza artificiale.

Occorre invece muoversi perchè le nuove tecnologie viaggiano molto velocemente.

Mi sembra la storia della formica e della cicala.

Dobbiamo dedicare del tempo, con i migliori scienziati e futurologi, a capire come mettere in sicurezza lo sviluppo della tecnologia.

Non avremo subito il nuovo tool di AI generativa dei video per fare il nostro advertising con un click ma magari potremo garantire un futuro più sicuro alle nuove generazioni.

Altri articoli correlati:

Il futuro degli Spot Pubblicitari con l'uso dell'Intelligenza Artificiale

Il Comment Marketing su Linkedin

Qual è il futuro dell'informazione

Cos'è l'intelligenza artificiale generale (AGI) e quali rischi ed opportunità presenta

Come stanno cambiando i motori di ricerca per effetto dell'Intelligenza Artificiale?

Cos'è l'effetto squalo nel mondo del Digital Marketing

Come funziona OpenAI e perchè è importante conoscere cosa accade al suo interno

Cos'è il Geocaching e come può servire per il marketing turistico

L'Executive Communications ed il Personal Brand dei CEOCome funziona e come sfruttare Chat GPT e GPT-4 con esempi di applicazione

Come essere unici nella creazione di contenuti e differenziarci dai sistemi di AI

Come cambia il SEO con Chat GPT

Cosa sono i modelli di attribuzione e perchè sono importanti nel digital marketing

Come cambia il modo di fare le campagne online con l'AI

Il piano di Elon Musk per rilanciare Twitter

Come funziona il metaverso, quali sono le principali piattaforme con limiti e potenzialità

Perchè adoro Elon Musk e quali sono i suoi punti di forza

Cos'è il bounce rate e l'engagement rate, come si calcola e perchè è importante

Qual è il nobel per l'informatica?

Come la tecnologia migliorerà la nostra salute

Come funziona l'algoritmo di Facebook e quali sono i post che spinge maggiormente

Quanti sono gli italiani che usano Internet? Quanti accedono da mobile e quanti da PC?

Qual è la psicologia degli haters e come gestirli?

Come creare un sistema di Digital Analytics in un mondo digitale

Guida al digital marketing, canali owned, earned, rented e paid

Cos'è la valutazione euristica e come farla per migliorare la UX

Come utilizzare il video nella strategia di marketing

Il modello delle competenze verticali e trasversali per avere successo nel mondo digitale

La strategia pull vs push: sei contadino o cacciatore?

Cos'è il Digital Marketing? Come funziona ed i principali strumenti

Come fare le analisi di marketing e content marketing utilizzando Google Trends

Come analizzare le menzioni ed il sentiment in rete con Google Alerts

Come non perdere nemmeno un'idea con gli appunti di Google Keep

Cos'è e come massimizzare la User Experience dei clienti

L'ecommerce del cibo: il ristorante online, il cloud kitchen ed i prodotti di largo consumo

Come fare un test di usabilità per migliorare le nostre proprietà digitali

Lo strumento fondamentale per la marketing intelligence ed il content marketing